Meta, der Mutterkonzern hinter

Facebook und

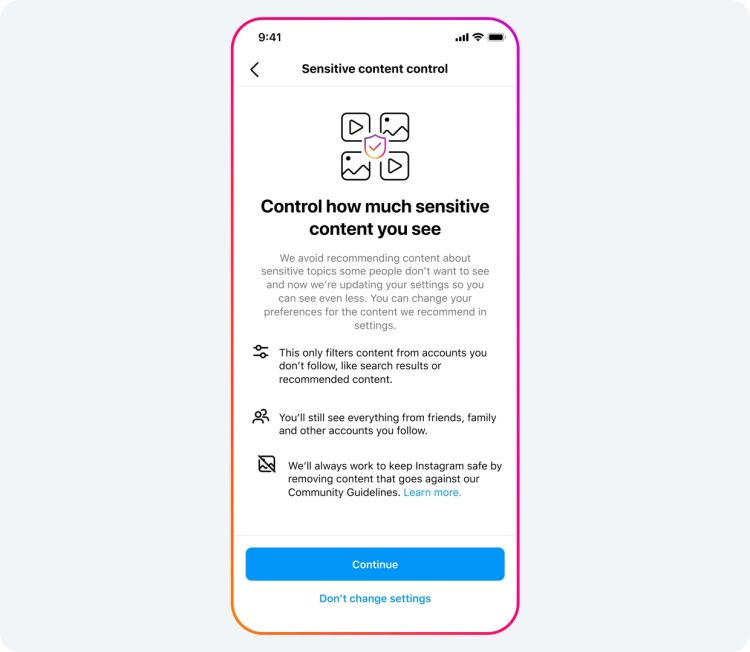

Instagram, will für seine Nutzer im Teenager-Alter die Sicherheit erhöhen. Dies mit einem neuen Content-Filter, der Teenies vor Inhalten schützen soll, die sich mit Essstörungen, Selbstverletzung und Suzid auseinandersetzen. Es soll zwar nach wie vor möglich sein, auf den beiden Plattformen über diese beiden heiklen Themen zu sprechen (was etwa bei der Verarbeitung helfe und Stigmatisierung verhindere), auf den Accounts von Teens sollen diese aber nicht mehr angezeigt werden.

Die Massnahme wurden gemeinsam mit entsprechenden Spezialisten für mentale Gesundheit entwickelt, man stehe weiter im ständigen Austausch mit den Experten, so

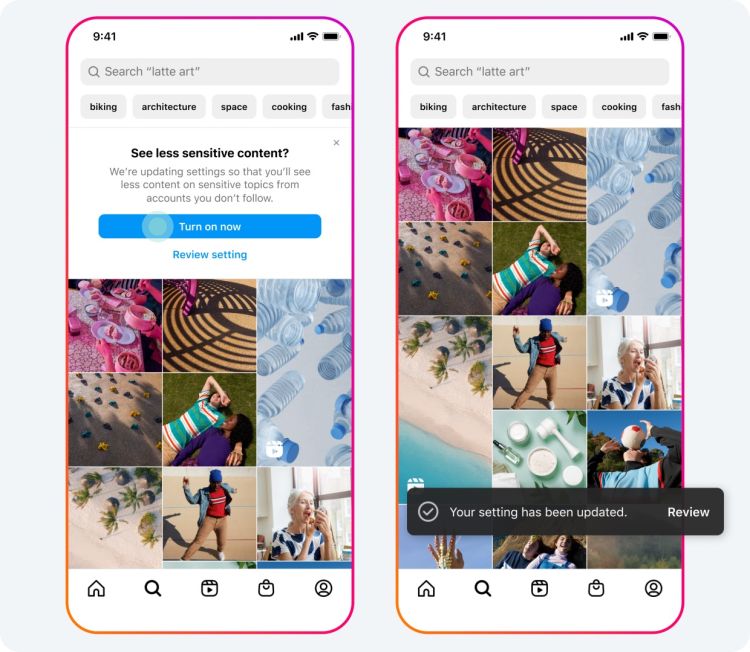

Meta. Bereits implementiert war schon zuvor die Massnahme, solche Inhalte nicht mehr bei den Reels oder in der Explore-Ansicht an Jugendliche auszuspielen. Neu ist hingegen, dass heikle Inhalte Kindern und Teenagern auch nicht angezeigt werden, wenn sie der Person folgen, die diese veröffentlicht. Die Altersgrenze für den Einsatz der Filter namens "Sensitive Content Control" (Instagram) und "Reduce" (Facebook) liegt bei 18 Jahren und wird fortan nicht mehr nur auf Neuzugänge, sondern auch auf bereits bestehende Accounts von Teenagern angewendet.

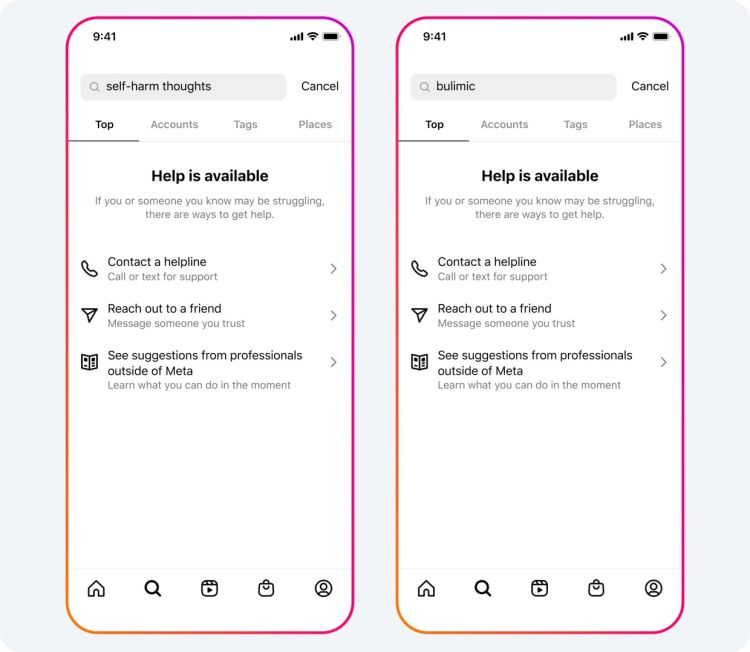

Dazu gibt es eine Änderung, die alle Nutzer betrifft: Wenn fortan nach Begriffen in den Themenbereichen Essstörungen, Selbstverletzung oder Suzid gesucht wird, werden im ersten Anlauf statt Suchergebnisse Kontaktmöglichkeiten zu entsprechenden Hilfsstellen angezeigt.

(win)