Mit KI lassen sich Fotos, Videos und Tonaufnahmen erschreckend einfach manipulieren – vom Fake-Statement eines Politikers bis zu gefälschten Privatfotos ist alles möglich. Social Media und Online-Plattformen seien voll von Deepfakes, stellt die

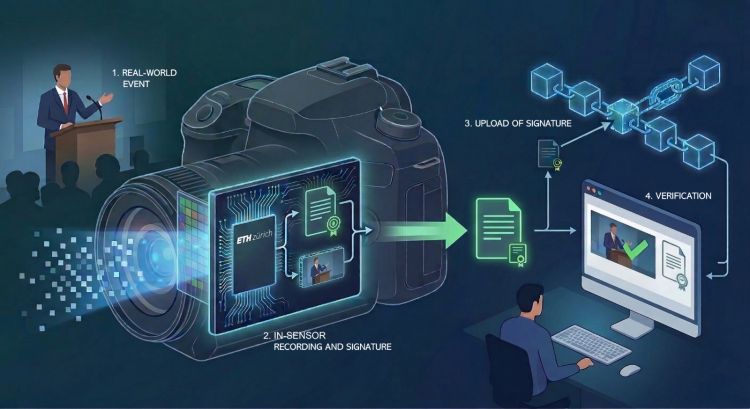

ETH Zürich fest und sieht gravierende Folgen für Gesellschaft und Demokratie. Im Kampf gegen Deepfakes haben ETH-Forschende eine neue Sensortechnologie entwickelt. Daten, Bilder oder Audiosignale werden damit direkt bei der Entstehung im Sensorchip kryptografisch signiert. Auf Basis dieser Signatur lässt sich später nachweisen, dass die Daten tatsächlich von einer Kamera oder einem Aufnahmegerät stammen. Gleichzeitig wird festgehalten, wann die Aufnahme genau erfolgt ist, und dass keine Manipulationen vorgenommen wurden.

Fernando Cardes, wissenschaftlicher Mitarbeiter an der Professur für Biosystems Engineering von Andreas Hierlemann im Department für Biosysteme (BSSE) in Basel Hat die Technologie mitentwickelt und erklärt: "Wenn Daten bereits bei ihrer Erstellung signiert werden, hinterlässt jede spätere Manipulation Spuren. Um Daten zu manipulieren, müsste der Chip physisch angegriffen werden – ein technischer Aufwand, der so hoch wäre, dass die massenhafte Herstellung manipulierter Inhalte für Social-Media-Plattformen praktisch verunmöglicht wird."

So funktioniert die Technologie: Ein reales Ereignis (1) wird von einer Kamera aufgezeichnet, deren Sensorchip im Moment der Aufnahme sowohl die Bilddaten als auch eine kryptografische Signatur erzeugt (2). Nach der Speicherung in einem öffentlichen Register (3) kann diese Signatur später verwendet werden, um zu überprüfen, dass die Aufnahme authentisch ist und nicht verändert wurde (4). (Quelle: Grafik erstellt mit KI: Felix Franke / ETH Zürich)

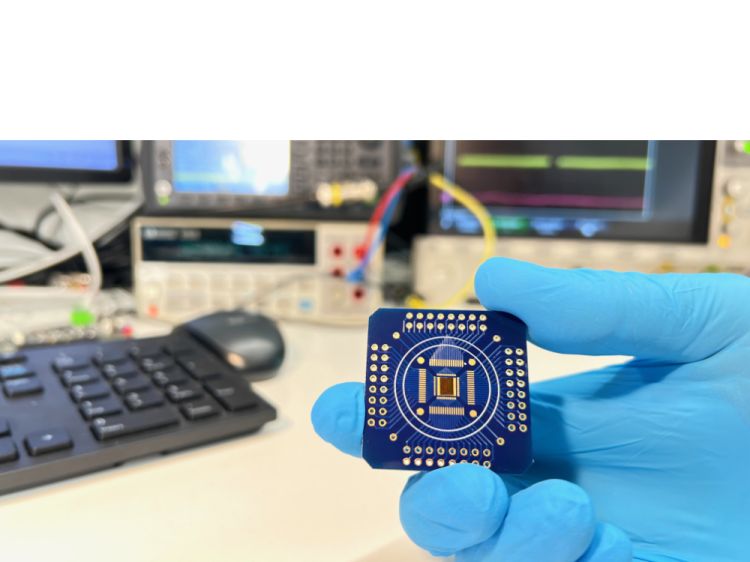

Der Sensorchip ist ein Prototyp, der die technische Machbarkeit demonstriert (Quelle: Caroline Arndt Foppa / ETH Zürich)

Ein öffentliches Register, unveränderbar gespeichert in einer Blockchain, könnten Kamerahersteller dazu nutzen, die Authentizität der Signatur zu verifizieren. Jede Person könnte die in einer Mediendatei enthaltene Signatur mit den Originaldaten abgleichen und so die Herkunft bestätigen. Die Technologie lässt sich grundsätzlich in alle Arten von Sensoren und Kameras integrieren. Social-Media-Plattformen könnten sie schon beim Hochladen automatisch prüfen, ob Inhalte echt sind. Falls dies nicht geschieht, könnten Dritte wie Journalisten oder Behörden die Echtheit mit einfachen Tools selbst verifizieren.

Das Forschungspaper, in dem die Technologie vorgestellt wird, präsentiert einen Chip als funktionierenden Prototypen und zeigt die technische Machbarkeit. Für einen kommerziellen Einsatz seien noch weitere Schritte nötig, hält die

ETH fest. Ein Patentantrag ist bereits eingereicht.

(ubi)